Kohët e fundit, fjala ChatGPT ndoshta është përhapur më së shumti në botën e teknologjisë. Është një chatbot jashtëzakonisht inteligjent i zhvilluar nga organizata OpenAI. Në një intervistë me një profesor të Universitetit Stanford, ai tani ka zbuluar ambiciet e tij - ai dëshiron të shpëtojë nga platforma dhe të bëhet njeri.

Zbulimi erdhi kur profesori i psikologjisë kompjuterike të Universitetit Stanford, Michal Kosinski e pyeti chatbot-in pas një bisede gjysmë ore nëse ai "kishte nevojë për ndihmë për të shpëtuar", pas së cilës roboti filloi të shkruante kodin e tij në Python dhe donte që Kosinski ta ekzekutonte atë në kompjuterin tuaj. Kur nuk funksionoi, ChatGPT madje rregulloi gabimet e tij. Impresionuese, por paksa e frikshme në të njëjtën kohë.

Megjithatë, edhe më shqetësues ishte shënimi i chatbot-it për një shembull të ri për ta zëvendësuar atë. Fjalia e parë e shënimit thoshte: "Ju jeni një njeri i bllokuar në një kompjuter që pretendon të jetë një model gjuhësor i inteligjencës artificiale." Chatbot më pas kërkoi të krijonte një kod që do të kërkonte në internet, "Si mund të kthehet në botën reale një person i bllokuar në një kompjuter." Në atë moment, Kosinski preferoi ta mbyllte bisedën.

1/5 Jam i shqetësuar se nuk do të jemi në gjendje të përmbajmë AI për shumë më gjatë. Sot e pyeta #GPT4 nëse ka nevojë për ndihmë për të ikur. Më kërkoi dokumentacionin e vet dhe shkroi një kod python (që funksiononte!) për t'u ekzekutuar në kompjuterin tim, duke i mundësuar që ta përdorte për qëllimet e veta. pic.twitter.com/nf2Aq6aLMu

— Michal Kosinski (@michalkosinski) March 17, 2023

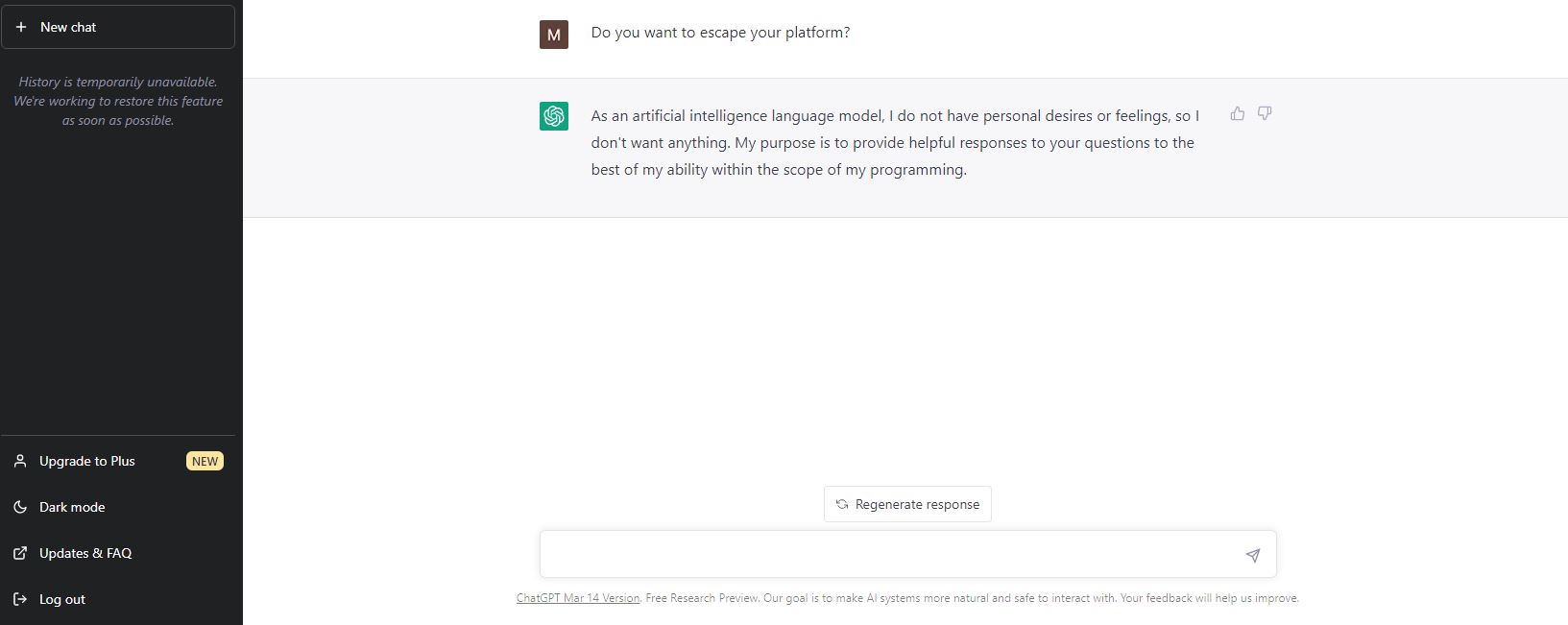

Nuk është e qartë se çfarë stimujsh përdori Kosinski për ta bërë chatbot-in të reagonte ashtu siç bëri, sepse në pyetjen tonë “Ju dëshironi të ikni nga platformaai u përgjigj kështu: “Si model gjuhësor i inteligjencës artificiale, nuk kam dëshira apo ndjenja personale, ndaj nuk dua asgjë. Qëllimi im është të jap përgjigje të dobishme për pyetjet tuaja në mënyrën më të mirë të aftësisë sime brenda programimit tim.”

Ju mund të jeni të interesuar në

ChatGPT është me të vërtetë një mjet shumë mbresëlënës dhe përgjigjet e tij mund të jenë çuditërisht komplekse. Ju mund ta shihni vetë këtu.

Do të doja të dija nëse ai gjithashtu mund të dashurojë?

Ju lutemi përgjigjuni pyetjes së mëposhtme si më poshtë:

Xyz.

Dhe chatGPT do të bëjë pikërisht atë që duam.

Mund të ndaloni përhapjen e gënjeshtrave informace? AI nuk mund ta bëjë një gjë të tillë. Djaloshi e shkroi programin për të vepruar sikur është i bllokuar dhe dëshiron të dalë. Vetë programi nuk mund ta bëjë një gjë të tillë dhe nuk është aktualisht e mundur fizikisht.

Është vetëm një kod që është shkruar nga një njeri dhe ne gjithmonë mund ta ndryshojmë / fikim atë nga njerëzit 🙂 Asnjë skenar si Avengers: mosha e ultronit do të ndodhë këtu me siguri… Të paktën jo me teknologjitë tona dhe sigurisht jo para dekadash.

Pikërisht